琉球大学工学部宮田龍太助教、理学部山田広幸准教授、伊藤耕介准教授らの共同研究チームによる研究成果が、Nature Research社の学術雑誌「Scientific Reports」誌に掲載されました。

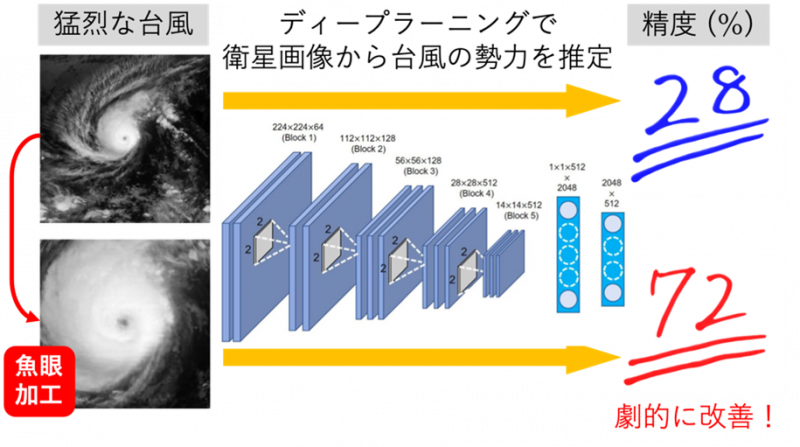

<発表のポイント>◆どのような成果を出したのか・・・気象学の専門知識を取り入れることで、単一の衛星画像から台風の強度クラスを高精度に推定するAIを実現。 ◆新規性(何が新しいのか)・・・衛星画像を魚眼レンズ風に加工して台風の眼や中心付近の雲の分布を強調した画像をディープラーニングに見せることで、気象学の専門家と似た視点を獲得し、先行研究よりも高い推定精度を達成。 ◆社会的意義/将来の展望・・・提案モデルにより最大強度クラス「猛烈な台風」の検出も大幅に改善されたため、防災・減災につながることが期待される。

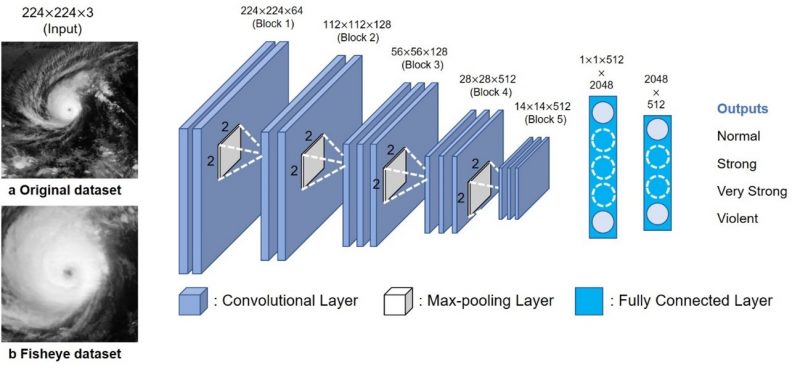

|

<発表概要>

- 誰がどのような成果を出したのか

琉球大学工学部の宮田龍太助教、理学部の山田広幸准教授、伊藤耕介准教授らの共同チームが、単一の衛星画像から台風の強度クラスを高精度に推定するAIを開発した。

今年3月に大学院理工学研究科博士前期課程を修了した比嘉舞輝氏の修士論文テーマであった本研究成果は、2021年06月21日にNature Researchから刊行された国際誌「Scientific Reports」のオンライン版に掲載されました。

- 新規性(何が新しいのか)

衛星画像を魚眼レンズ風に加工した前処理により台風の眼や中心付近の雲分布を強調した画像をディープラーニングに見せることで気象学の専門家と似た視点を獲得し、先行研究よりもはるかに高い推定精度を達成した(図1)。

「衛星画像を魚眼レンズ風に加工する」アイデアは長年の台風研究で衛星画像を見続けてきた山田准教授によるものであり、気象学の知見をデータサイエンスに取り入れられたからこそ、今回のブレイクスルーは実現できた。

- 社会的意義/将来の展望

台風は沖縄県にとって最も身近で危険な自然災害であり、正確な台風強度推定は気象学の分野でとくに重要な課題である。

提案モデルにより最大強度クラスである「猛烈な台風」の検出力も大幅に改善されたため、防災・減災につながることが期待される。

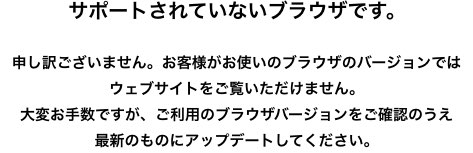

図1: 本論文の提案モデル。オリジナルの衛星画像(a)を魚眼レンズ加工した台風画像(b)をディープラーニングに入力することで、正答率76.8%で台風の強度クラスを分類。

<発表内容>

①研究の背景・先行研究における問題点

台風は世界で最も危険な自然災害の一つであるため、その強さを正確に分類することは、気象学の分野でとくに重要な課題となっています。多くの台風は陸地から離れた海上で一生の大半を過ごすため、安定した観測が可能なのは人工衛星からのみという場合がよくあります。そのため、衛星画像に写った台風の雲の形を手がかりとして現在の台風の強さを定量的に推定するドボラック法やその周辺技術が気象庁の現業では広く使われています。

ただし、ドボラック法1ではいかに衛星画像から台風の強さに関係する雲の特徴を抽出するかが問題で、各国の気象機関での手順の違いや予報官の能力によって推定結果にばらつきが生じてしまうことが報告されています。

このような分類のあいまいさを軽減するために、画像認識で画期的な成果を挙げたディープラーニング(深層学習)を活用し、AIでドボラック法を自動化する試みがいくつか行われてきました。一例として、プラドハンら(2018)2が提案したハリケーン強度の分類モデルがあります。彼らは機械学習の定石に従ってデータをトレーニング用とテスト用でランダムに分割し検証した結果、分類精度82%を達成しました。

しかし、台風といった時系列データに上記のランダム分割を適用すると実用時には得られない将来の傾向をAIが学習する“データ漏洩”(例えば、ある日の12時のデータでAIをトレーニングしてその3時間前の9時のデータをテストに出すことは、AIに“予知夢”を見せることになります)を引き起こしてしまうため、例えば2010年までのデータでトレーニングし2011年以降でテストするなど、データを時間で分割する必要がありました。

実際に予備実験としてプラドハンらと同様のモデルでデータをランダム分割でなく時間で分割して検証すると、精度が55.7%に低下してしまいました。

②研究内容(具体的な手法など詳細)

本研究では次の2つのアイデアで先行研究における問題点を解決しました。

1つ目が“より層が深い”ディープラーニングを使うことです。先行研究で使われていたのは5層構造と比較的浅くて単純(ゆえにポピュラー)なモデル3でした。

台風のもっと細かい雲のパターンを衛星画像から捉えるにはこの多層化が必要であると考え、16層のモデル4を使ったところ精度を68.9%まで改善できました。しかしまだ課題は残っており、最強クラスである「猛烈な台風」に関しては28%しか当てられませんでした。

そこで2つ目に登場するのが「ディープラーニングに見せる衛星画像に専門家の知見を活かした前処理を施す」というアイデアです。筆頭著者の比嘉氏らは、山田准教授や伊藤准教授との議論を通じて、気象学の専門家は台風の衛星画像を見る際「台風の眼が画像にはっきり現れているか」や「眼の周りに雲が同心円状に分布しているか」といった台風の中心付近に現れる特徴をよく見ていることを知りました。

よって、衛星画像を魚眼レンズ風に加工して台風の眼や中心付近の雲の分布を強調することでディープラーニングが台風の特徴的な雲パターンを認識しやすくなるのではないかと考えました。そして、魚眼レンズ風に加工した衛星画像をディープラーニングに見せた結果、推定精度を76.8%まで(先行研究より約20%)改善できました。さらにこの方法だと、猛烈な台風に関しても72%の精度を達成しました。

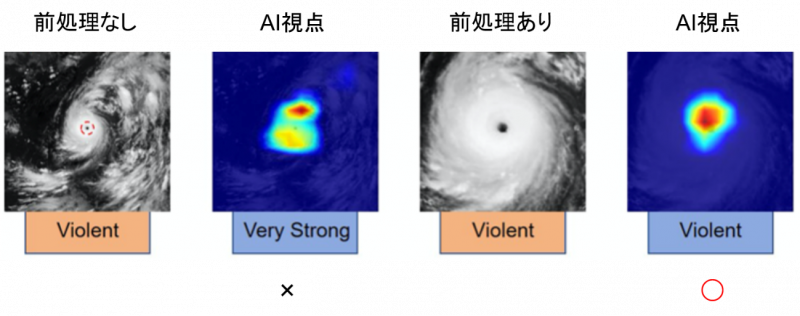

さらに図2の通り、ディープラーニングがクラス分類で画像のどこを見て判断したのか可視化5したところ、オリジナルの衛星画像では猛烈な台風で一番わかりやすい特徴である「はっきりとした眼」をちゃんと捉えられていない一方、魚眼レンズ風に加工した画像ではしっかり眼に着目していることが確認でき、簡単な前処理で専門家と定性的に似た視点をAIが獲得できたことがわかりました。

図2: AIが画像のどこを見てクラス分類したかヒートマップで可視化(赤色部分はAIが重視した領域)。オリジナルの衛星画像(前処理なし)ではAIが注視できていなかった台風の眼と中心付近の雲分布(最強クラスである「猛烈な台風」の特徴)について、魚眼レンズ風に加工した(前処理あり)画像ではしっかりと認識できていることがわかる。

③社会的意義・今後の予定

一連の分析から、ディープラーニング手法の改良のみに頼るデータドリブンアプローチには限界があることがわかります。先行研究ではディープラーニングの性能を上げるためにオリジナルの画像をいろんな角度に回転させたりノイズを加えるなどしてトレーニングデータの水増しを行っていましたが、衛星画像で同じ手法を用いると台風としては不自然なデータも学習してしまうため、AIが人間と異なる視点を獲得してしまう要因の一つとなっていました。

一方、本研究では上記のようなデータの水増しをせず、衛星画像を魚眼レンズ風に加工する前処理だけで高精度を達成できました。この事実は同時に、データサイエンスは専門家の知見を活用することで新たなブレイクスルーを生み出せる可能性も示唆しています。

今回はたった一枚の衛星画像からAIがどのくらい台風の勢力に関連する情報を引き出せるかに重点を置いた研究でしたが、衛星画像を撮影した時点での台風の緯度経度や台風が発生してからの経過時間といった情報も取り入れると、さらなる精度向上が見込めるかもしれません。

今後はこれまで培ってきたノウハウを基に台風勢力の解析や予測を行っていく予定で、台風が急速に発達する前兆をAIで捉えたいと考えております。

<参考文献>

- Dvorak, V. F. (1973) A technique for the analysis and forecasting of tropical cyclone intensities from satellite pictures. NOAA Tech. Memo. NESS 45: 19.

- Pradhan, R., Ramazan, S. A., Maskey, M., Ramachandran, R., & Cecil, D. J. (2018) Tropical cyclone intensity estimation using a deep convolutional neural network. IEEE Trans. Image Process. 27(2): 692–702.

- LeCun, Y., Haffner, P., Bottou, L., & Bengio, Y. (1999) Object recognition with gradient-based learning. Shape Contour Group. Comput. Vis. 1681: 319–345.

- Simonyan K., & Zisserman A. (2015) Very deep convolutional network for large-scale image recognition. arXiv: 1409.1556.

- Selvaraju R. R. et al. (2017) Grad-CAM: visual explanations from deep networks via gradient-based localization. arXiv: 1610.02391.

<謝辞>

- 本研究は、平成31年度琉球大学戦略プロジェクト研究「大気-海洋-生態系結合モデルを核とした総合的台風研究プロジェクト」( 18SP01302)の助成を受けました。

- 台風画像と台風情報については、国立情報学研究所で「デジタル台風」プロジェクトを進める北本朝展教授から提供いただきました。

- 台風の雲パターン情報については、気象庁から提供いただきました。

<論文情報>

- 論文タイトル Domain Knowledge Integration into Deep Learning for Typhoon Intensity Classification

(台風強度分類のためのディープラーニングへのドメイン知識の融合) - 雑誌名 Scientific Reports

- 著者 Maiki Higa, Shinya Tanahara, Yoshitaka Adachi, Natsumi Ishiki, Shin Nakama, Hiroyuki Yamada, Kosuke Ito, Asanobu Kitamoto, and Ryota Miyata

(比嘉 舞輝1, 棚原 慎也1, 足立 佳隆1, 石木 夏実2, 名嘉眞 紳2, 山田 広幸3,伊藤 耕介3, 北本 朝展4, 宮田 龍太2

1琉球大学大学院理工学研究科, 2琉球大学工学部, 3琉球大学理学部, 4国立情報学研究所コンテンツ科学研究系) - DOI番号 https://doi.org/10.1038/s41598-021-92286-w

- アブストラクトURL https://www.nature.com/articles/s41598-021-92286-w